期末复习:

监督类型:有监督学习,半监督学习,无监督学习(区别重点)

有监督学习:分类,回归(预测值)

有监督学习算法:线性回归,逻辑回归,决策树,随机森林

无监督学习算法:PCA,奇异值分解,单类SVM,t-SNE

机器学习的主要挑战:训练数据的数量不足、训练数据不具代表性、无关特征、过拟合训练数据、欠拟合训练数据

过拟合处理方法: 简化模型(选择较少参数的模型,例如选择线性模型而不是高阶多项式模型); 减少训练数据中的属性数量,或者是约束模型; 收集更多的训练数据; 减少训练数据中的噪声(例如,修复数据错误和消除异常值);

欠拟合处理方法: 选择一个带有更多参数、更强大的模型; 给学习算法提供更好的特征集(进行特征工程); 减少模型中的约束(例如,减少正则化超参数);

选择性能指标:RMSE(均方根误差Root Mean Square Error,对异常值更加敏感),MAE(平均绝对值误差,Mean Absolute Error)

数据处理方法:特征缩放 MinMaxScaler() \[ X_{std} = \frac{X - X_{min}}{X_{max} - X_{min}} \] StandardScaler() \[ X_{std} = \frac{X - \mu}{s} \]

K-折交叉检验:随机分为k个子集,k-1个训练,1个评估,进行k次训练,得到的分数取平均值

评价指标:混淆矩阵,精度,召回率,F1分数,Roc曲线 精度 \[ Precision = \frac{TP}{TP + FP} \] 召回率 \[ Recall = \frac{TP}{TP + FN} \] F1分数 \[ F1-score = \frac{2 \times Precision \times Recall }{Precision + Recall} \] ROC曲线 Receiver Operating Characteristic,受试者工作特征曲线,为FPR与TPR之间的关系曲线。FPR、TPR(Recall)分别表示代价和收益,显然收益越高、代价越低,模型性能越好。 \[ \begin{align} TPR = \frac{TP}{TP+FN},真阳性率 \\ \\ FPR = \frac{FP}{TN+FP},假阳性率 \end{align} \]

梯度下降:

学习曲线概念:学习曲线就是通过画出不同训练集大小时训练集和交叉验证的准确率,可以看到模型在新数据上的表现,进而来判断模型是否方差偏高或偏差过高,以及增大训练集是否可以减小过拟合。机器学习中学习曲线的妙用

正则化模型:岭回归,Lasso,弹性网络。正规化

逻辑回归:(二分类问题)

理解SVM的运作原理:

支持向量机基本型:

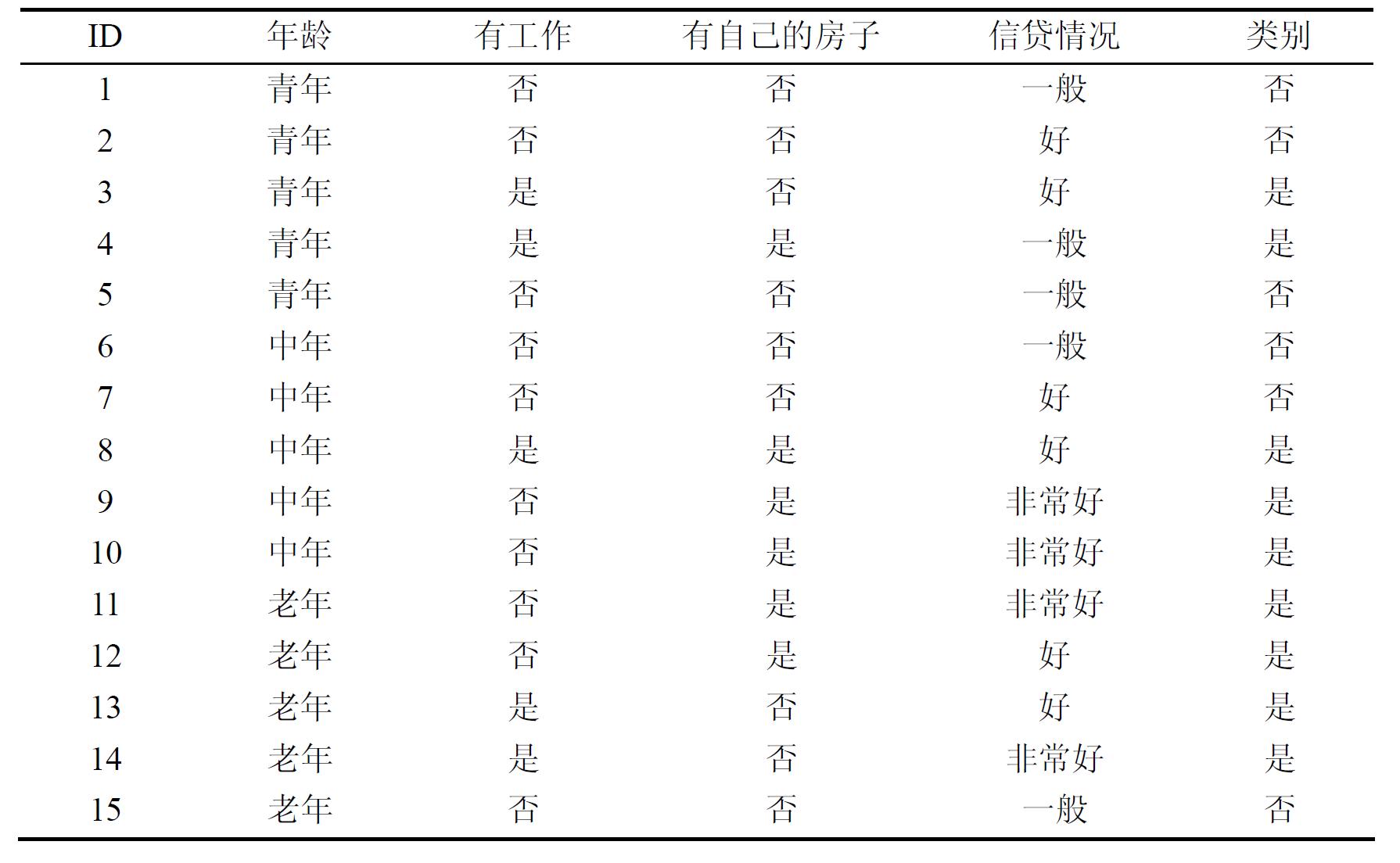

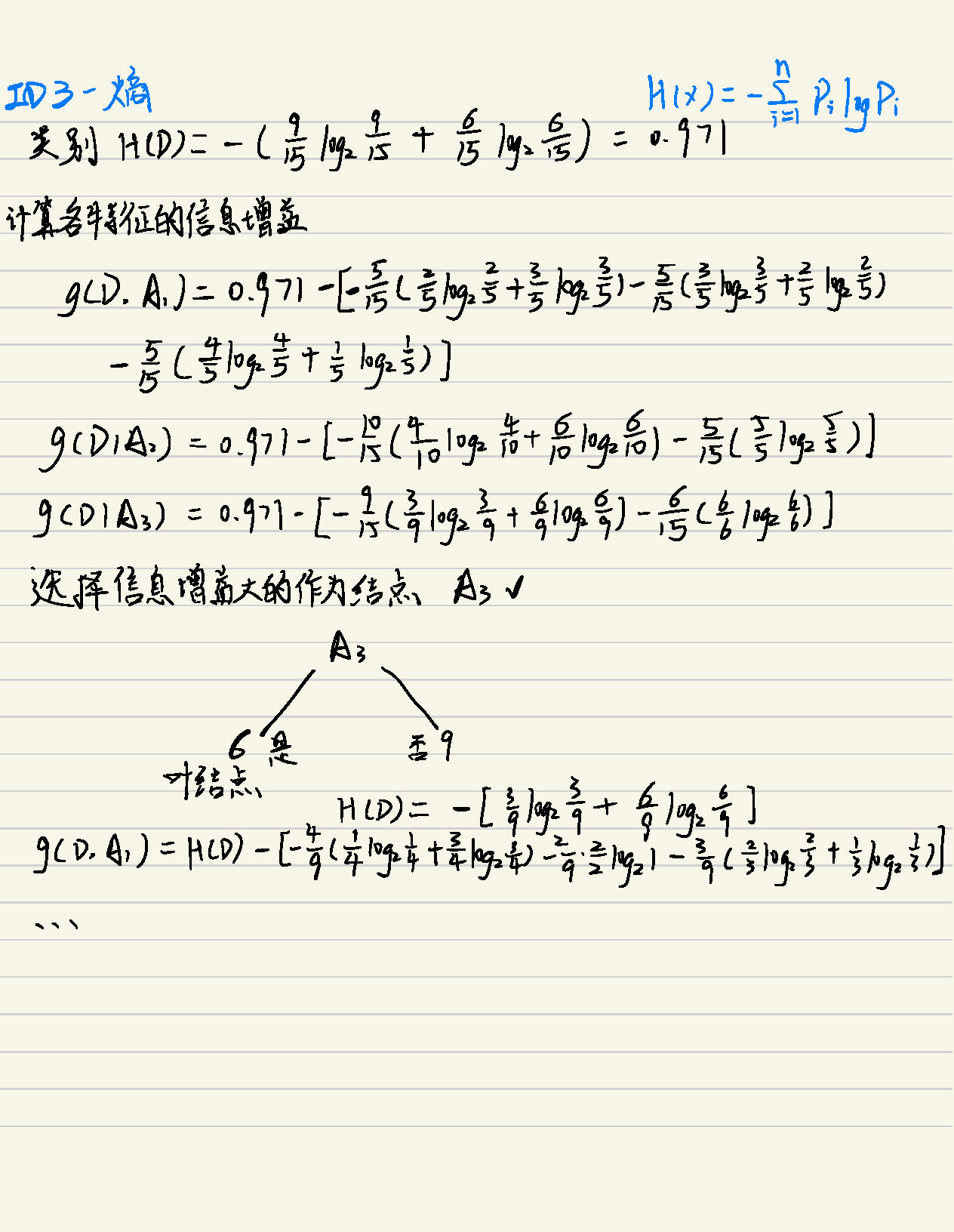

决策树模型计算(ID3算法): Data:

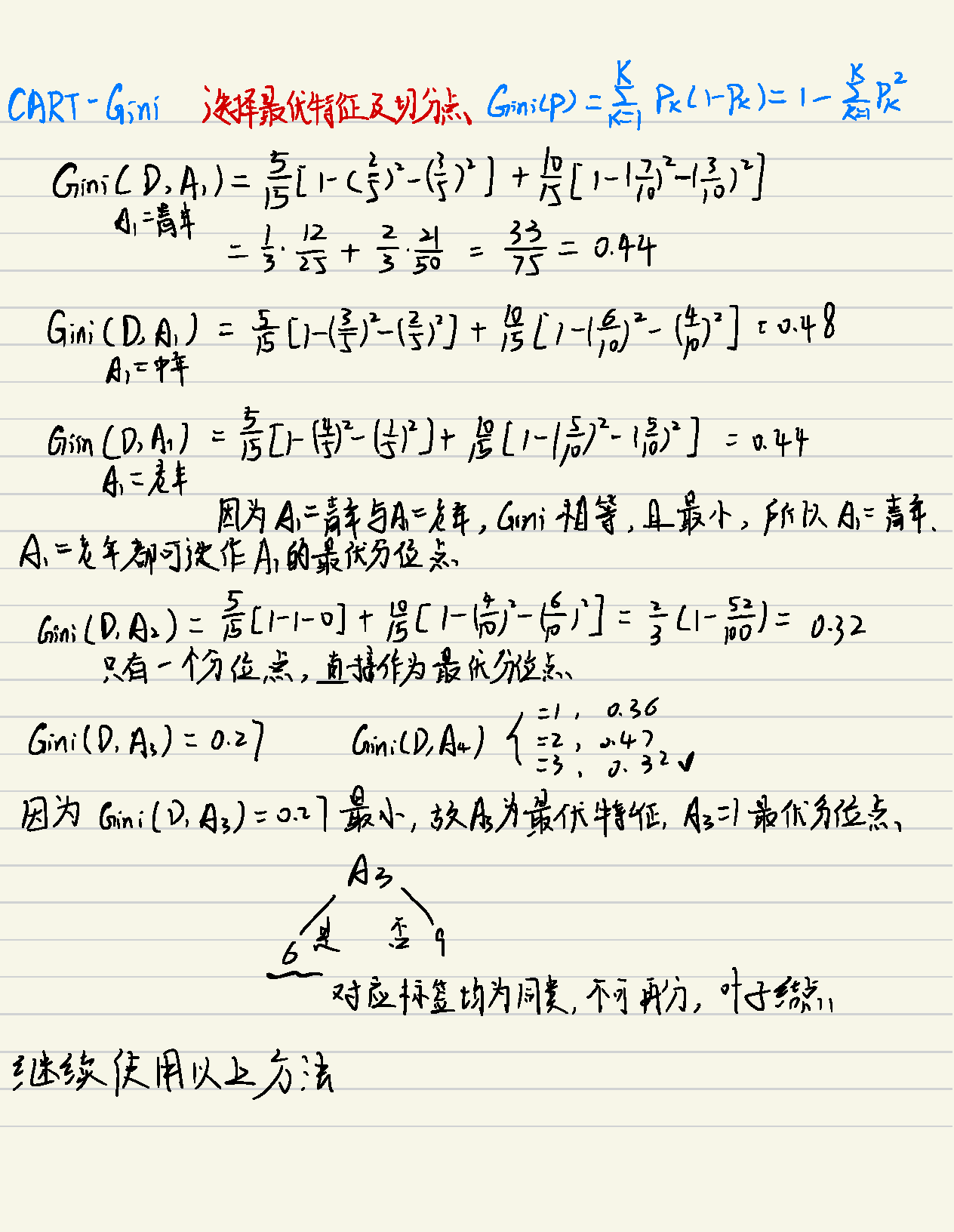

决策树模型计算(CART算法):

Bagging(并行,有放回选取):思想“三个臭皮匠,顶个诸葛亮。”

Boosting(串行,不断调整样本权重) :思想“Your best teacher is your last mistake.” Bagging和Boosting的总结

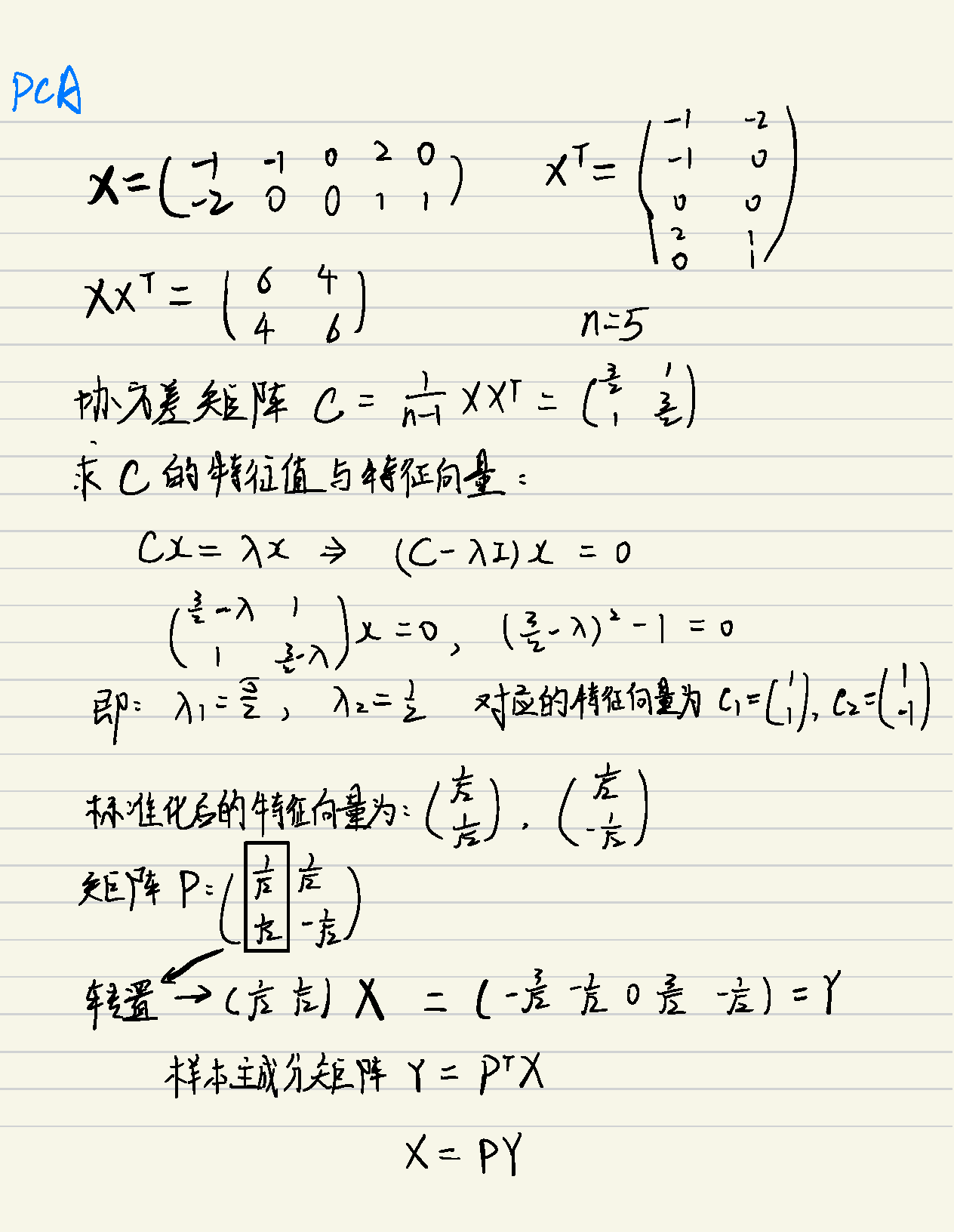

主成分分析PCA的思想和计算(计算:去平均值,计算协方差矩阵,特征值和特征向量):